Вниманието на човештвото денес е насочено кон вештачката интелигенција (ВИ). OpenAI обезбедувајќи бесплатен пристап до chatbot-от ChatGPT и објавување на социјални мрежи на дотерувани слики создадени со помош на Midjorney и други невронски мрежи ја направи оваа алатка поблиска од кога било до обичните корисници на интернет.

Како што пренесува Укринформ, ова ги актуелизираше дискусиите за ризиците и можностите што ги носи вештачката интелигенција како дел од информациските војни.

Како вештачката интелигенција помага во работата со информации

ВИ има голем потенцијал за создавање и обработка на содржина. Центарот за стратешка комуникација и безбедност на информации користи способности за вештачка интелигенција за следење на медиумскиот простор и анализа на низа онлајн публикации. Станува збор за автоматизирани алатки, вклучувајќи ги и платформите SemanticForce и Attack Index.

SemanticForce им помага на корисниците да ги идентификуваат информациските трендови, да ги следат промените во одговорот на корисниците на социјалните медиуми на вести и настани, да идентификуваат говор на омраза итн. Друг вектор на апликацијата на невронската мрежа е деталната анализа на слики, која овозможува брзо откривање на несоодветна или злонамерна содржина.

Индексот на напад користи машинско учење (проценка на тоналитетот на пораките, рангирање на изворите, предвидување на развојот на динамиката на информации), анализа на кластери (автоматизирано групирање на текстуални пораки, откривање на заплети, формирање на синџири на приказни), компјутерска лингвистика (за да се идентификуваат воспоставените фрази и наративи), формирање, групирање и визуелизација на семантички мрежи (за одредување врски и јазли, развој на когнитивни мапи) и анализа на корелација и брановидни (за откривање на тековни психопи).

Достапните алатки овозможуваат разлика помеѓу органска и координирана дистрибуција на содржина, откривање на автоматизирани системи за дистрибуција на спам, проценка на влијанието врз публиката на одредени кориснички сметки на социјалните медиуми, кажување на ботови од вистински корисници и многу повеќе – сето тоа користејќи вештачка интелигенција.

Овие алатки може да се користат и за откривање дезинформации, за анализа на кампањи за дезинформации и за развивање контрамерки.

Потенцијал на вештачката интелигенција за создавање и ширење дезинформации

Речиси секој ден, невронските мрежи демонстрираат подобрување на нивните способности во креирањето графички, текстуални и аудиовизуелни содржини. Неговиот квалитет ќе се подобри со оглед на можностите на машинското учење. Денес, популарните невронски мрежи се користат од корисниците на Интернет повеќе како играчка отколку како алатка за создавање фалсификати.

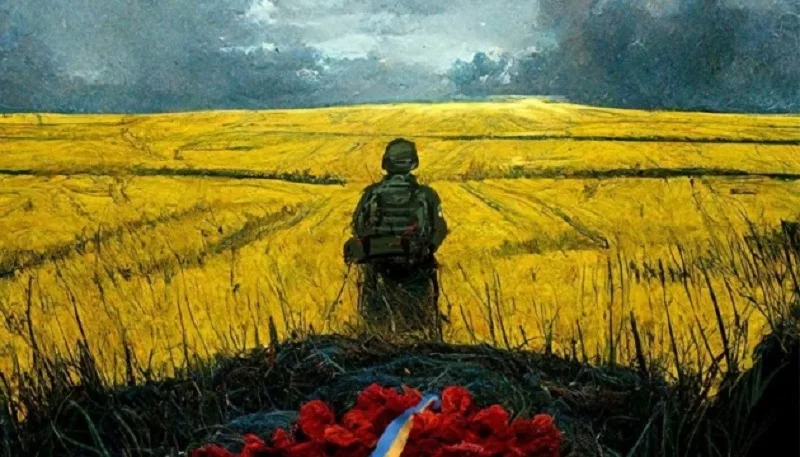

Сепак, веќе има примери за тоа како сликите генерирани од невронските мрежи не само што станаа вирални, туку и корисниците ги доживуваа како реални. Особено, сликата на „момче кое преживеа ракетен напад во Днипро“ или „Путин го поздравува Кси Џинпинг на колена“.

Овие примери јасно покажуваат дека сликите дизајнирани со помош на невронски мрежи веќе се натпреваруваат со вистинските во однос на нивниот емоционален набој, а тоа секако ќе се користи за целите на дезинформации.

Студијата на аналитичкиот центар NewsGuard, спроведена во јануари 2023 година, покажа дека ChatGPT може да генерира текстови кои ги развиваат веќе постоечките теории на заговор и вклучуваат вистински настани во нивниот контекст. Алатката има потенцијал за автоматска дистрибуција (преку бот фарми) на повеќе пораки, чија тема и тон ќе ги одредува човечки оператор, но нивниот текст ќе биде генериран од вештачка интелигенција. Веќе денес, со помош на овој бот, може да се креираат дезинформациски пораки, вклучително и оние засновани на наративите на пропагандата на Кремљ – со формулирање соодветни барања. Спречувањето на ширењето на вештачки генерирана лажна содржина е предизвик на кој веќе треба да бидеме подготвени да одговориме.

Воена употреба на вештачката интелигенција: што да очекуваме од Русите

Руските специјални служби, кои веќе имаат огромно искуство во користење на уредување фотографии и видеа за создавање фалсификати и водење психолошки операции, сега активно ја совладуваат вештачката интелигенција. Технологијата Deepfake се базира на вештачка интелигенција. Тоа беше искористено, особено, за создавање на лажно видео обраќање на претседателот Зеленски за „предавање“ на Украина што се појави во медиумскиот простор во март 2022 година.

Со оглед на лошиот квалитет на овој „производ“, брзата реакција на државните комуникациски тела, претседателот, кој лично го поби лажниот, и новинарите, ова прашање не доби многу покриеност. Видеото не ја постигна целта ниту во Украина, ниту во странство. Но Русите очигледно нема да застанат на тоа.

Денес, Кремљ користи огромен број алатки за циркулирање на дезинформации: ТВ, радио, веб-страници, пропагандни блогови на Телеграма, Јутјуб и социјалните мрежи.

Вештачката интелигенција има потенцијал да се користи првенствено за создавање фалсификати за фотографии, аудио и видео, како и за фарми за бот. Вештачката интелигенција може да замени значителен дел од човечкиот персонал во руските „фабрики за тролови“, интернет воини кои предизвикуваат конфликти на социјалните мрежи и создаваат илузија за масовна поддршка за наративите на Кремљ на интернет.

Наместо „тролови“ кои пишуваат коментари според одредени водичи, тоа може да го направи со вештачка интелигенција користејќи.

Подготви: Д. Мишев (ЦивилМедиа)